it之家 5 月 2 日消息,谷歌的一名前 ai 工程師日前爆料,該公司曾經開發出一款能夠自主思考的人工智慧對話系統,但後來因為擔心其安全性和而將其刪除。他還稱,谷歌目前還有更先進的人工智慧技術沒有公開。

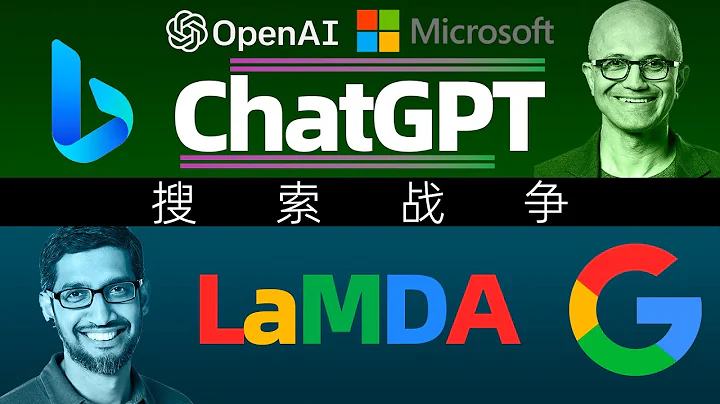

這名工程師叫布萊克・勒莫恩(blake lemoine),曾經是谷歌負責人工智慧的團隊成員,it之家注意到,他就是此前曾稱人工智慧聊天機器人已經擁有自我意識而被谷歌解僱的工程師。他在接受《未來主義》(futurism)雜誌採訪時說,他認為谷歌在人工智慧領域是在「以他們認為安全和負責的方式」行事,並不是被 openai 這樣的組織所左右。openai 在 2022 年底發布了一款名為 chatgpt 的人工智慧對話系統,短時間內便火爆全球。

勒莫恩還透露,谷歌其實早在 2021 年中就開始研發一款類似於 chatgpt 的聊天系統,他說:「當時它還沒有叫 bard,但是他們正在研究它,並且試圖弄清楚是否安全地發布。他們本來打算在 2022 年秋天發布,所以本來會在 chatgpt 發布之前或者同時發布。但是,部分因為我提出的一些安全問題,他們把它刪除了。」

勒莫恩於 2015 年加入谷歌,他還告訴《未來主義》雜誌,谷歌目前還有「更先進的技術」沒有公開。他說,兩年前就有一款產品基本上具備了 bard 的功能,但是谷歌一直在「確保其不會太經常地編造事實、沒有種族或性別偏見,或者政治偏見之類的東西。」

勒莫恩去年 6 月曾經告訴《華盛頓郵報》,他相信谷歌的語言模型對話應用(lamda)在與他聊天后獲得了自我意識。他還在 medium 上分享了一個他與 lamda 進行的「採訪」,並聲稱這是證明其獨立思想的證據。他在那個月後被谷歌解僱,谷歌稱他違反了公司的保密政策。一位谷歌公司的代表當時稱,他的自我意識說法是沒有根據的,並且沒有任何證據表明 lamda 有意識。